- IA Con Sentido

- Posts

- IA con Sentido #2: Tu newsletter semanal de IA Responsable en Español.

IA con Sentido #2: Tu newsletter semanal de IA Responsable en Español.

Qué pasó, por qué importa y qué haría hoy: titulares + la sed oculta de la IA esta semana.

👋🏻 ¡Hola!

Bienvenido a la segunda edición de ”IA con Sentido”.

Esta semana volví a leer todo lo que pude y me quedé con lo que de verdad mueve decisiones en IA responsable, en español y con foco en nuestra comunidad.

En minutos verás qué pasó, por qué importa y qué haría hoy.

Spoiler: el riesgo de la semana va sobre la “sed” de la IA, un problema real que nos pega directamente.

Gracias por estar aquí; empecemos 👇

P.D.: Si te sirve, compártela con tu equipo y dime qué tema de tu país/sector quieres ver la próxima semana.

LOS CINCO TITULARES QUE TE IMPORTAN HOY

Top 5 noticias de la semana

✋¿Cómo la gente usa ChatGPT?

→ OpenAI publicó el mayor estudio de uso de ChatGPT: 1.5 M de chats, 700 M de usuarios semanales, adopción acelerada en países de ingresos bajos/medios, tutoría, escritura/edición, traducción, salud y recomendaciones.

🌎 Brecha global creciente

→ La OMC advierte que la adopción de IA podría aumentar la desigualdad económica entre países ricos y pobres si no se amplía el acceso a infraestructura digital y hardware.

🇺🇸 EE. UU. acelera la formación en IA

→ El Departamento de Trabajo insta a los estados a incorporar cursos y a usar fondos de reserva para expandir capacitaciones laborales para jóvenes, adultos y trabajadores desplazados.

🏫 Universidades evolucionan guía para IA

→ Un estudio de UNESCO revela que ~67 % de instituciones de educación superior tienen o están desarrollando directrices para uso de herramientas de IA; 25 % ya reportan problemas éticos como dependencia excesiva, sesgos o disputas de autoría.

👧 Niñez en riesgo digital

→ La FTC pide a siete compañías de IA informes sobre protección infantil y uso de datos en asistentes conversacionales.

✍🏼 Mi apunte: La semana gira a infancia + formación: más controles a chatbots y más upskilling; si no cerramos brecha de infraestructura, la desigualdad se agranda.

👉🏼 Si estuviera en tu lugar: Actualiza tu política de menores (detección de edad, consentimiento, borrado) y reserva presupuesto de formación trimestral para equipos clave.

LO MÁS RELEVANTE DEL MUNDO HISPANO

¿Qué pasó en la Hispanósfera ?

Porqué esta sección: Son pistas locales para decidir sin copiar marcos “importados”.

🇨🇱 Debate de Chile sobre riesgo inaceptable

→ Avanza una propuesta de ley que prohibiría sistemas de IA que representen riesgo “inaceptable” como manipulación emocional, deepfakes sexuales o recolección biométrica sin consentimiento explícito.

🇲🇽 Enfoque humano‑seguridad en México

→ UNESCO, la FAO y la OIT lanzan en Jalisco un programa centrado en “human security” para fomentar una IA ética, inclusiva y sostenible incorporando salud, empleo, ambiente y derechos.

🇧🇷 Semáforo en ámbar para Brasil

→ La Comisión Europea emitió un borrador de adecuación que, si se confirma, habilitará transferencias de datos personales UE↔︎Brasil sin cláusulas extra, pendiente del EDPB y de los Estados miembros.

👉🏼 Si estuviera en tu lugar: Revisa que ningún piloto caiga en riesgo inaceptable (manipulación, biometría sin consentimiento, deepfakes íntimos) + asegura que tus proyectos estén alineados al enfoque de human security.

EL PULSO GLOBAL QUE TE IMPACTA LOCALMENTE

¿Qué más pasó en el mundo ?

Cómo lo leo yo: 3 vectores: sandbox pro-innovación, protección de infancia y control algorítmico.

🇺🇸 Sandbox legislativo en EE.UU.

→ El senador Ted Cruz propuso un proyecto de ley para crear un “sandbox regulatorio” que permitiría a empresas de IA operar bajo exenciones parciales de regulaciones federales por hasta 10 años, sujeto a condiciones.

🇪🇺 Menores y pantallas: alerta europea

→ La Comisión pedirá a expertos un plan de límites de acceso en redes para la infancia, con recomendaciones antes de fin de año y foco en Australia.

🇨🇳 Semáforo Ético para Algoritmos en China

→ Se plantea revisión por paneles para usos de alto riesgo que afecten salud, emociones u opinión pública, con decisiones en 30 días, marcado visible/oculto del contenido y ofensiva contra granjas de bots ante desafíos judiciales.

🇦🇱 Ministra Digital sin DNI

→ Albania despliega un sistema de IA para supervisar la contratación pública y promete licitaciones libres de corrupción, mientras expertos y opositores alertan sobre falta de rendición de cuentas y dudas constitucionales.

🇮🇪 Avance en implementación del AI Act en Irlanda

→ Designó 15 Autoridades Competentes nacionales para hacer cumplir el AI Act de la UE, estableció un punto único de contacto para coordinar regulación, innovación y vigilancia.

🇮🇳 India pide regulación dinámica

→ La ministra de Finanzas de India, Nirmala Sitharaman, dijo que la regulación debe mantenerse al día con la rápida adopción de IA, y que la ética no puede quedarse rezagada.

🇦🇺 Cerebro patrio en marcha

→ Están recaudando fondos para desarrollar Sovereign Australia AI, un modelo fundacional de inteligencia artificial de propiedad australiana.

👉🏼 Si estuviera en tu lugar: Prueba etiquetado de contenido generado, define un flujo de AIA-lite para pilotos y verifica si algún sandbox aplica a tu sector.

MOVIMIENTOS DE EMPRESAS

¿Y a nivel empresarial ?

🚸 Modo Defensa Joven

→ OpenAI aplica restricciones para menores en ChatGPT: estimación de edad, controles familiares, bloqueo de explícitos y alertas ante señales de crisis.

📜 Emails-trampa y consentimiento coercitivo

→ La CNIL impuso €325 millones a Google por anuncios camuflados en Gmail y forzar la aceptación de cookies al crear cuentas, exigiendo corregir en 6 meses o afrontar sanciones diarias.

🧷 Consejo de Seguridad Nacional sobre IA

→ Anthropic convocó exsenadores y altos exfuncionarios para asesorar al gobierno en usos de inteligencia artificial (de ciberdefensa a investigación) y reforzar estándares y cooperación público-privada.

⚖️ OpenAI atrasado con el Reglamento de la UE

→ Aún no ha publicado el resumen de datos de entrenamiento de GPT-5 exigido a los GPAI posteriores al 2 de agosto de 2025 por el AI Act, mientras la AI Office define si es “modelo nuevo” y la exigibilidad práctica de esa obligación empieza en agosto de 2026.

✍🏼 Mi apunte de Riesgo: 🟡 privacidad/consentimiento en emails, cookies, opt-out por defecto.

👉🏼 Si estuviera en tu lugar: Activa opt-out por defecto, documenta base legal y añade banner BYOAI con reglas de datos y revisión humana.

📩 ¿Te gusta esta edición? Reenvíala a alguien que también quiera aprender sobre IA sin complicarse. Así me ayudas a seguir compartiendo contenido útil y gratuito.

DE QUIENES MUEVEN LA AGENDA REGULATORIA

Organizaciones y Estándares

🌏 OECD lanza informe clave

→ La OECD publicará hoy el informe “Governing with Artificial Intelligence: The State of Play and Way Forward in Core Government Functions”, que estudia ~200 casos reales de uso de IA en 11 funciones gubernamentales.

🔈Stanford : Tu paper, primer paso

→ Concurso de escritura en IA otorga US$1,000 y feedback experto a alumnos de grado; cierre 15 de octubre.

🌏 Proyecto global de regulación colaborativa

→ A través de ITU / AI for Good, se abre un proyecto (“YAIL Global Project”) para que participantes de todo el mundo investiguen y propongan marcos regulatorios nacionales y regionales de IA.

👉🏼 Si estuviera en tu lugar: Cruza tus controles con casos OECD (1:1) y postula un caso o herramienta de tu institución.

LECTURAS RELEVANTES Y SERIAS DE LA SEMANA

¿Qué leer este fin?

📊 Atlantico lanza 'Latin America Digital Transformation Report 2025’.

→ Revela fondos con retornos top, adopción masiva de IA, compañías nativas eficientes, auge de data centers, México en punto de inflexión y valor por cientos de miles de millones.

✋ Radiografía de ChatGPT

→ OpenAI reporta 1.5 millones de chats y 700 millones de usuarios semanales, con adopción acelerada en países de ingresos bajos/medios, 70% uso personal y 30% laboral, y más…

📚 Stanford habla sobre neutralidad política en la IA

→ El paper sostiene que la imparcialidad política perfecta no se logra y propone ocho técnicas para aproximarla, con un marco de evaluación aplicado a diez modelos y un llamado a más investigación y transparencia.

✏️ Cinturón de seguridad para Copilots

→ El whitepaper fija 5 áreas y 10 pasos para gestionar agentes en Microsoft 365 con permisos, Purview, CoE, monitoreo y gasto bajo control.

✍🏼 Mi apunte : entender la pluralidad de la transformación digital en Latinoamérica para adaptar mis servicios y productos.

BASES DE DATOS, REPOS LISTOS PARA USAR

Recursos útiles

✅ OECD.AI muestra su compendio de confianza algorítmica

El organismo invita a proponer herramientas y métricas para evaluar sistemas de inteligencia artificial con transparencia y comparabilidad global.

✅ México con datos abiertos a un clic

El portal oficial concentra miles de conjuntos y APIs públicas para impulsar transparencia, investigación y soluciones cívicas.

👉🏼 Cómo lo uso yo: guardo 3 herramientas “favoritas” y comparo métricas para auditoría.

PLANTILLA DE LA SEMANA

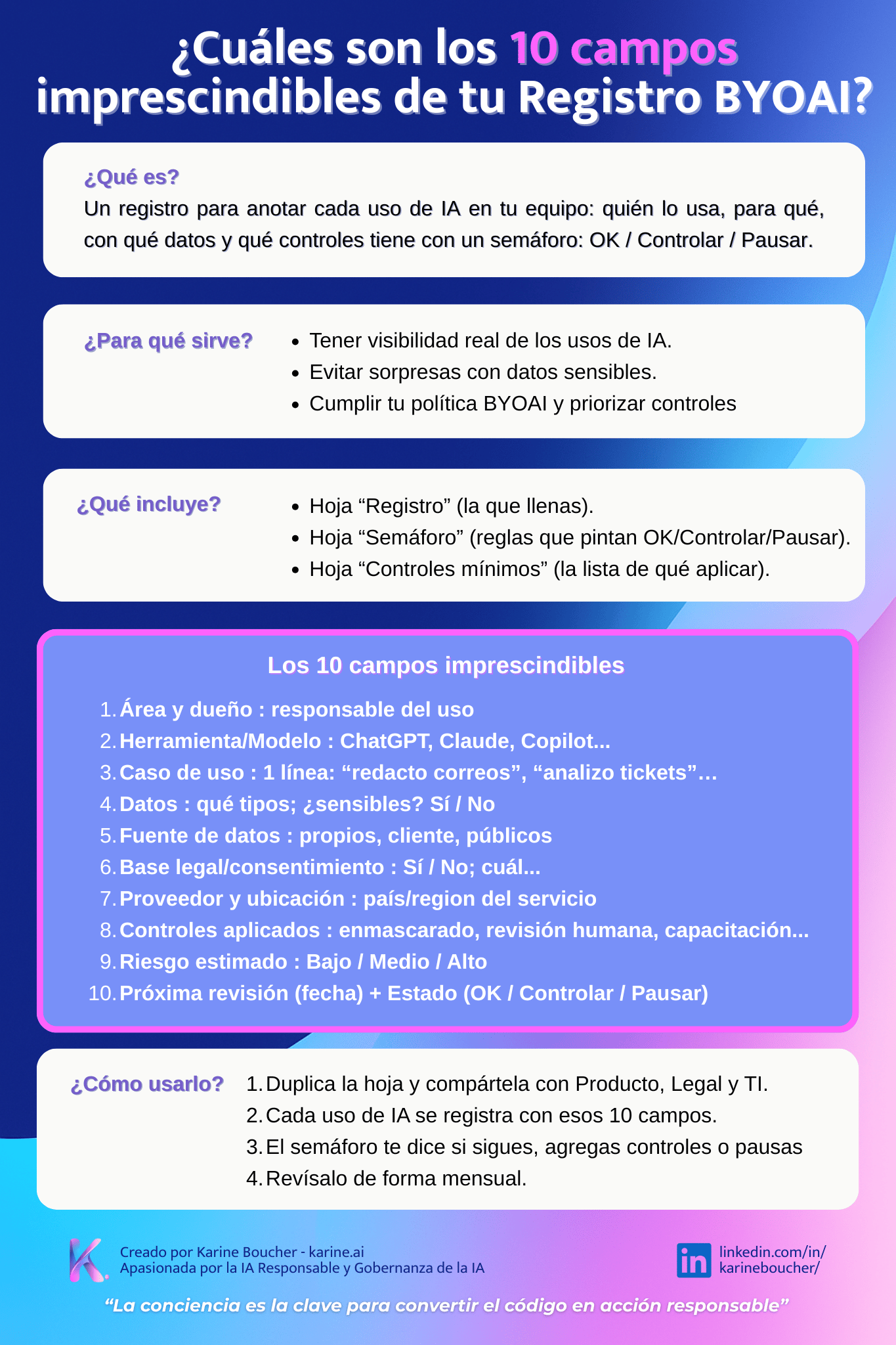

✅ 10 campos imprescindibles de tu Registro BYOAI

Gracias a este registro, puedes mapear quién usa qué herramienta de IA, con qué datos y bajo qué controles.

Incluye todo lo necesario como Registro, Semáforo y Controles mínimos. ✍🏼 Cómo lo uso yo: me encanta difundir este tipo de plantillas para cuidar el uso de herramientas de IA. |

¿Lo hacemos juntos?

“BYOAI Express” te ayuda en implementar esta plantilla de usos de IA, análisis de riesgos y controles mínimos y plan 30/60/90.

📢 Tienes un equipo o comunidad interesada en IA Responsable?

Comparte esta newsletter con ellos.

HUMOR RESPONSABLE

El chiste ético de la semana

¡Y hasta aquí por hoy!

Gracias por llegar al final. Esta edición nació de lo que yo también necesitaba entender esta semana.

Si algo te sirvió, respóndeme y cuéntame qué decisión tienes en puerta o qué tema quieres ver; puedo ayudarte o traerlo (anónimo) en la próxima.

¿Conoces a alguien a quien le pueda servir? Reenvíala o pásale el link de suscripción.

Nos leemos el jueves que viene 💌

P.S.: Leo todas las respuestas: si hay algo que quieras que cubra o quieres compartir tus ideas, solo dímelo!

Que tengas un excelente día! Con gratitud y té en mano ☕, Karine Mamá, apasionada con la IA Responsable a beneficio de las personas y también AI Governance Consultant & WiAIG Mexico Leader |

Todas las fuentes fueron verificadas y con fecha; si ves un error, respóndeme y lo corrijo en la versión web.