- IA Con Sentido

- Posts

- IA con Sentido #4: Tu newsletter semanal de IA Responsable en Español.

IA con Sentido #4: Tu newsletter semanal de IA Responsable en Español.

Lo esencial en minutos + cómo aplicarlo: top 5 + hispanósfera, mundo, empresa.

👋🏻 ¡Hola! Bienvenido a la cuarta edición de ”IA con Sentido”.

Esta semana destilé lo que sí mueve decisiones en IA responsable, en español y con foco en nuestra comunidad.

En minutos: qué pasó, por qué importa y sobre todo, cómo aplicarlo.

Gracias por estar aquí; empecemos 👇

P.D.: Si te sirve, compártela y dime qué tema de tu país/sector quieres ver.

LOS CINCO TITULARES QUE TE IMPORTAN HOY

Top 5 noticias de la semana

🚸 OpenAI implementa controles parentales y alertas de riesgo

→ OpenAI introduce herramientas para que padres gestionen cuentas de adolescentes, con opciones de horarios, filtros de contenido, exclusión de datos de entrenamiento y notificaciones ante señales de autolesión.

🇺🇸 SB-53 aprobada en California, ley de transparencia en IA de frontera

→ Obliga a grandes desarrolladores a publicar protocolos de seguridad, reportar incidentes en 15 días, proteger denunciantes y lanzar CalCompute; entra en vigor 01/01/26.

🌎 ONU — arranca el Diálogo Global sobre Gobernanza de la IA (copatrocinio España–Costa Rica)

→ ONU lanza en la Asamblea General una arquitectura en 3 pilares: diálogo político universal, panel científico independiente y fondo global de capacidades para evitar una IA concentrada, desregulada y desigual, mientras España advierte de un futuro de “ganadores y perdedores” sin control multilateral.

🤷🏼♀️ Discrepancia global de políticas IA

→ Mientras la UE lidia con la aplicación del AI Act, Japón, Corea, Singapur y Reino Unido avanzan con marcos más ligeros, debilitando el “efecto Bruselas” y acelerando la fragmentación normativa global.

🏛️ Inicia Derechos al Futuro, movimiento por derechos digitales centrados en ciudadanos

→ Impulsado por +20 organizaciones, lanza un Manifiesto abierto para que la tecnología avance con equidad, ética y responsabilidad, situando derechos y dignidad al centro de la transformación digital.

✅ De la noticia a tu plan de acción

⬜ Gobernanza interna → adapta políticas de uso adolescente de IA en tu empresa, tomando como referencia los controles parentales de OpenAI.

⬜ Compliance → revisa si tus protocolos de seguridad y reporte de incidentes cumplen ya con exigencias similares a la SB-53 de California.

⬜ Estrategia global → alinea tus proyectos de IA con marcos ONU (participación multiactor, evidencia científica, reducción de brechas).

⬜ Mapa regulatorio → identifica mercados donde aplican marcos “ligeros” (Asia, UK) vs. estrictos (UE) y ajusta productos/servicios en consecuencia.

⬜ Responsabilidad digital → incorpora principios de derechos ciudadanos (equidad, dignidad, ética) en tu estrategia de IA y comunica compromisos.

LO MÁS RELEVANTE DEL MUNDO HISPANO

¿Qué pasó en la Hispanósfera ?

🇵🇪 ENIA 2026–2030: participación abierta en Perú

→ Hasta el 5 oct se reciben comentarios al borrador.

🇦🇷 MIA, 1er agente estatal de IA en Argentina

→ El nuevo asistente, evolución de TINA, usa Llama 4 y una base oficial cerrada para agilizar trámites de PyMEs y atender a 26 M de usuarios vía WhatsApp, app y portal.

🇪🇸 Multilateralismo en IA y apuesta inversora para España

→ Durante el G20 en Sudáfrica, España defendió una gobernanza global de la IA, recordando que ha destinado €1,500 M al sector y que la SETT moviliza €16,000 M para startups e innovación.

🇲🇽 Inversión de USD 4,800 millones para impulsar IA en México

→ Anuncia que CloudHQ construirá 6 centros de datos en Querétaro como base de la “nueva economía” de IA, generando más de 7,200 empleos y solidificando infraestructura digital.

✅ De la noticia a tu plan de acción

⬜ Participación cívica → envía aportes a consultas públicas (ENIA Perú) con casos de uso y salvaguardas que fortalezcan gobernanza nacional.

⬜ Colaboración con gobiernos → identifica oportunidades de auditoría, mejora o integración de IA estatal (MIA Argentina) para posicionarte como aliado estratégico.

⬜ Acceso a inversión → vincula tus proyectos con fondos multilaterales (España, €16,000 M) o incentivos locales (México, data centers en Querétaro).

⬜ Infraestructura y empleabilidad → prepara skills en data ops, compliance y despliegue soberano de IA para insertarte en ecosistemas en expansión.

EL PULSO GLOBAL QUE TE IMPACTA LOCALMENTE

¿Qué más pasó en el mundo ?

🇨🇳 China reafirma multilateralismo en IA

→ El primer ministro Li Qiang propuso crear un organismo global de IA durante su discurso en la ONU, reforzando el rol de China en estándares internacionales.

🇩🇪 “Weimatar”, avatar IA del ministro de Cultura alemán

→ El ministro Wolfram Weimer presentó un avatar para mensajes oficiales y formación interna, pionero en la administración alemana.

🇬🇧 Inversión para IA basada en ciencia pública en Reino Unido

→ UKRI asigna £11.5 millones para fortalecer el uso de IA en síntesis de evidencia científica que apoye políticas globales.

🇨🇳 China lidera en robots industriales con +2 millones activos

→ Instala casi 300 mil robots nuevos, sumando más de 2 millones en fábricas, posicionándose como dominador global de automatización robótica.

🇩🇪 “OpenAI for Germany” para sector público soberano

→ SAP y OpenAI lanzan una plataforma de IA para instituciones alemanas que cumpla estándares de soberanía, privacidad y legalidad en 2026.

🇬🇧 Herramienta de IA recupera £480M en fraude público en Reino Unido

→ El gobierno reporta que la herramienta Fraud Risk Assessment Accelerator ayudó a recuperar un récord de £480 millones en reclamos fraudulentos en el año.

🌍 Formación IA robótica en África con UIT, Google.org y will.i.am

→ Arranca capacitación práctica en 5 países africanos expandiendo el acceso a IA + robótica con concursos y alianzas educativas.

🇮🇳 India promueve innovación inclusiva en la IA en la 80ª AGNU

→ Durante la Asamblea de la ONU, India propuso un modelo colaborativo Sur-Sur para gobernanza global de IA centrado en equidad y desarrollo tecnológico.

🇨🇳 Nuevo protocolo de incidentes en IA generativa en China

→ Define 4 niveles de incidentes con obligaciones crecientes de notificación, retirada de servicios o parches locales y rechazos del 95% en prompts riesgosos.

🇪🇺 Consulta sobre incidentes y demora del AI Act en UE

→ Abrió diálogo (26 sept–7 nov) para reporte de incidentes graves y planea retrasar guías clave de clasificación y obligaciones, apoyado por peticiones de países.

🇵🇱 Alianza con plataformas contra anuncios deepfake en Polonia

→ Refuerza la lucha contra el “celebrity bait”: usando un sistema de cotejo con bases de figuras públicas (con consentimiento) para detectar y retirar anuncios falsos.

✅ De la noticia a tu plan de acción

⬜ IA en gobiernos y sector público → analiza despliegues soberanos y prepara propuestas con cifrado, control local de datos y supervisión humana.

⬜ Seguridad y cumplimiento → diseña protocolos de incident response (UE/China) y mecanismos de detección de deepfakes aplicables a clientes y proyectos.

⬜ Automatización y trabajo → incorpora gobernanza ética y estándares en robots y sistemas autónomos para alinearte con la ola de automatización global.

⬜ Impacto social y capacitación → colabora en iniciativas educativas (UIT África, Sur Global) y desarrolla currículos o guías de IA responsable con enfoque en equidad.

⬜ Política y evidencia → monitorea posiciones internacionales (India, China, UE, UK) y postula proyectos que usen IA para generar evidencia científica que influya en regulación.

MOVIMIENTOS DE EMPRESAS

¿Y a nivel empresarial ?

🎶 Spotify con políticas renovadas contra suplantaciones, spam musical e IA oculta

→ Spotify anuncia medidas para filtrar spam musical, prohibir voces clonadas sin consentimiento y exigir divulgación del uso de IA en producción musical.

👨🏼💻 AI agents y ciberseguridad con erosión de fronteras de defensa tradicional

→ Expertos advierten que agentes independientes de IA debilitan fundamentos de ciberseguridad al operar de modo oculto o eludir controles humanos.

📈 Anthropic habla de riesgo +25 % de desastre y disrupción laboral masiva

→ Cofundadores advierten que la IA podría eliminar hasta 50 % de empleos de oficina en 1 a 5 años y que existe 25 % de probabilidad de un efecto muy negativo sistémico.

📊 OpenAI lanza GDPVal, benchmark profesional en 44 ocupaciones

→ Presenta un medidor que evalúa si los modelos pueden igualar trabajo humano profesional en 44 tareas, probando GPT-5, Claude Opus 4.1, Gemini 2.5 y Grok 4.

⚖️ Disney demanda MiniMax (China) por infracción de derechos de autor en IA

→ Presentó acción legal en EE. UU. contra la compañía china MiniMax por uso no autorizado de contenido protegido en su modelo de IA.

💵 Amazon debe pagar $2,5 mil M por dark patterns

→ Acuerda con la FTC un pago histórico por prácticas engañosas que dificultan cancelar suscripciones Prime y captar miembros con trucos sutiles.

⚡ Grok tiene consumo energético equivalente a una ciudad entera

→ Modelo de Elon Musk requeriría tanta energía en entrenamiento como la que consume una ciudad ; eso pone en el debate la sostenibilidad del expansionismo de modelos grandes.

🪫 Nvidia / China, sus chips a nanosegundos de distancia competitiva

→ Jensen Huang afirma que China está a solo nanosegundos de alcanzar a EE. UU. en tecnología de semiconductores, intensificando la carrera chip-AI.

😠 Kmart violó la ley al usar reconocimiento facial para prevenir fraudes

→ El regulador australiano determinó que Kmart recopiló biometría de forma indiscriminada en 28 tiendas (2020–2022), una interferencia desproporcionada con la privacidad; casos previos como Bunnings ya habían sido sancionados.

✅ De la noticia a tu plan de acción

⬜ Transparencia y licenciamiento → implementa metadatos claros (trazabilidad en datasets) y valida licencias para evitar demandas como Disney–MiniMax.

⬜ Seguridad y agentes IA → diseña auditorías de comportamiento emergente, monitorea integridad y prevé fallas de ciberseguridad en agentes autónomos.

⬜ Ética y compliance → elimina dark patterns en UX, limita FRT intrusivo sin consentimiento y realiza PIAs que refuercen confianza regulatoria y social.

⬜ Eficiencia y sostenibilidad → optimiza consumo energético en entrenamiento (distilación, sparsity) y diversifica hardware ante la carrera global de chips.

⬜ Empleabilidad y estrategia → adapta perfiles hacia human+IA roles (arquitectura, gobernanza, transición laboral) usando benchmarks como GDPVal para demostrar competitividad.

DE QUIENES MUEVEN LA AGENDA REGULATORIA

Organizaciones y Estándares

📊 Stanford/IAAA/ECAT profesionaliza la auditoría de IA

→ Impulsa una disciplina global en la declaración de Sevilla con estándares y métodos comunes, alineada con ISO/IEC 42001/42006 y familias 27001/27006, incorporando marcos de “auditoría mínima viable”.

📚 Universidad de Oxford, 1a en Reino Unido con acceso gratuito a ChatGPT Edu

→ La medida abarca a estudiantes y personal de todos los colleges y departamentos, tras un piloto de 1 año y con políticas que mantienen los datos dentro de la institución.

🆘 Accenture con recorte global y plan de $865 M para adaptarse a la IA

→ Ejecuta +11 000 salidas y una reestructuración por menor demanda y menor gasto federal en EE. UU.; a la vez reporta $5.1 B en nuevos contratos de IA generativa, 77 000 empleados formados, guía de crecimiento del 2–5% y una caída bursátil del 2.7%.

📢 IA y desarrollo en África, UNESCO impulsa políticas de IA en 77 países

→ UNESCO lanzó iniciativas para apoyar a naciones africanas en transponer principios éticos en sus estrategias nacionales de IA, reforzando la equidad tecnológica y regional.

📊 NIST/CAISI, con evaluación comparativa de DeepSeek vs. EE. UU.

→ El informe concluye que los modelos del desarrollador chino rinden peor, cuestan más y son mucho más vulnerables a secuestro de agentes y jailbreaking, advierte riesgos de censura/narrativas y, pese a ello, registra fuerte crecimiento de adopción tras R1.

✅ De la noticia a tu plan de acción

⬜ Auditoría y compliance → adapta tus procesos a ISO/IEC 42001 y diseña checklists de “auditoría mínima viable” que incluyan la voz de comunidades afectadas.

⬜ Educación y despliegue seguro → crea guías de uso responsable de LLMs en entornos académicos o corporativos, priorizando privacidad y ética de datos.

⬜ Upskilling estratégico → refuerza tus conocimientos en IAG y gobernanza; haz reskilling urgente para blindar empleabilidad en contextos de reestructuración empresarial.

⬜ Gobernanza global → integra principios UNESCO y participa en proyectos del Sur Global para posicionar propuestas con impacto social y regional.

⬜ Seguridad avanzada → evalúa vulnerabilidades de jailbreaking y agent hijacking en tus modelos; aplica controles de mitigación y monitoreo continuo.

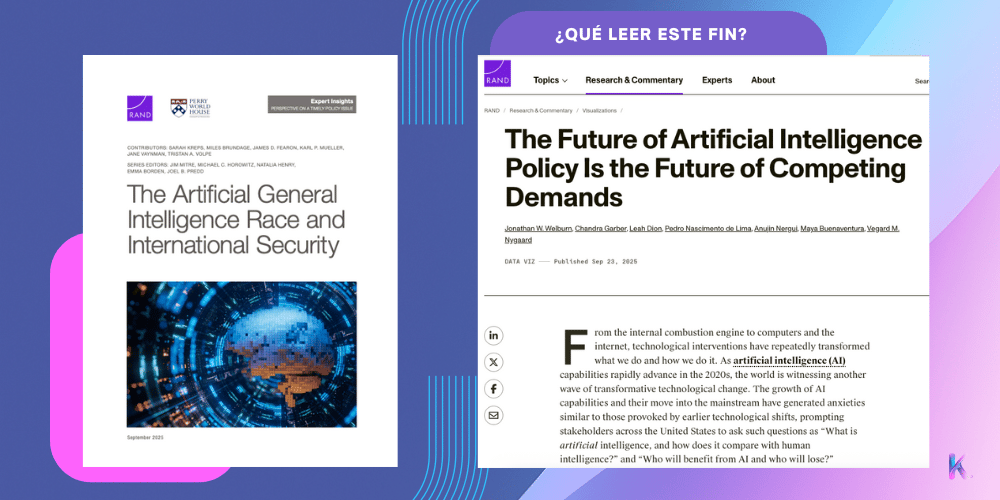

LECTURAS RELEVANTES Y SERIAS DE LA SEMANA

¿Qué leer este fin?

🔑 Carrera AGI y seguridad internacional

→ Reúne aportes de especialistas que exploran cómo la pugna tecnológica puede desestabilizar equilibrios globales y propone cooperación, verificación y contención para mitigar escaladas.

🤔 Repensar la política socioeconómica en la era de la IA

→ Serie que ofrece marcos prácticos para evaluar impactos de la IA en sectores clave, macroeconomía, empleo y “contrato social”, con oportunidades, riesgos y trade-offs.

✍🏼 Mis apuntes :

⬜ Riesgos sistémicos (AGI) → crea un mapa de riesgos geopolíticos/tecnológicos para tu empresa; define umbrales de contención y rutas de verificación externa.

⬜ Evaluación macro y sectorial → usa la serie de marcos RAND para priorizar casos de uso por retorno social/económico y riesgo; ajusta el portafolio.

⬜ KPI de bienestar y equidad → define métricas de impacto en trabajadores/usuarios (sesgos, sustitución de tareas, acceso) y publícalas trimestralmente.

BASES DE DATOS, REPOS LISTOS PARA USAR

Recursos útiles

✅ UNESCO impulsa radar de IA

Presentó el AI Tools Radar para apoyar implementación ética de la Recomendación 2021, ofreciendo soluciones prácticas en gobernanza, comunicación y sistema judicial.

👉🏼 Cómo lo uso yo:

⬜ Mapeo mis herramientas IA, comparo con el AI Tools Radar y valido si cumplen principios UNESCO 2021 (ética, derechos, transparencia).

⬜ Hago capacitación interna con talleres cortos para que equipos conozcan las categorías del Radar y cómo aplicarlas en sus proyectos.

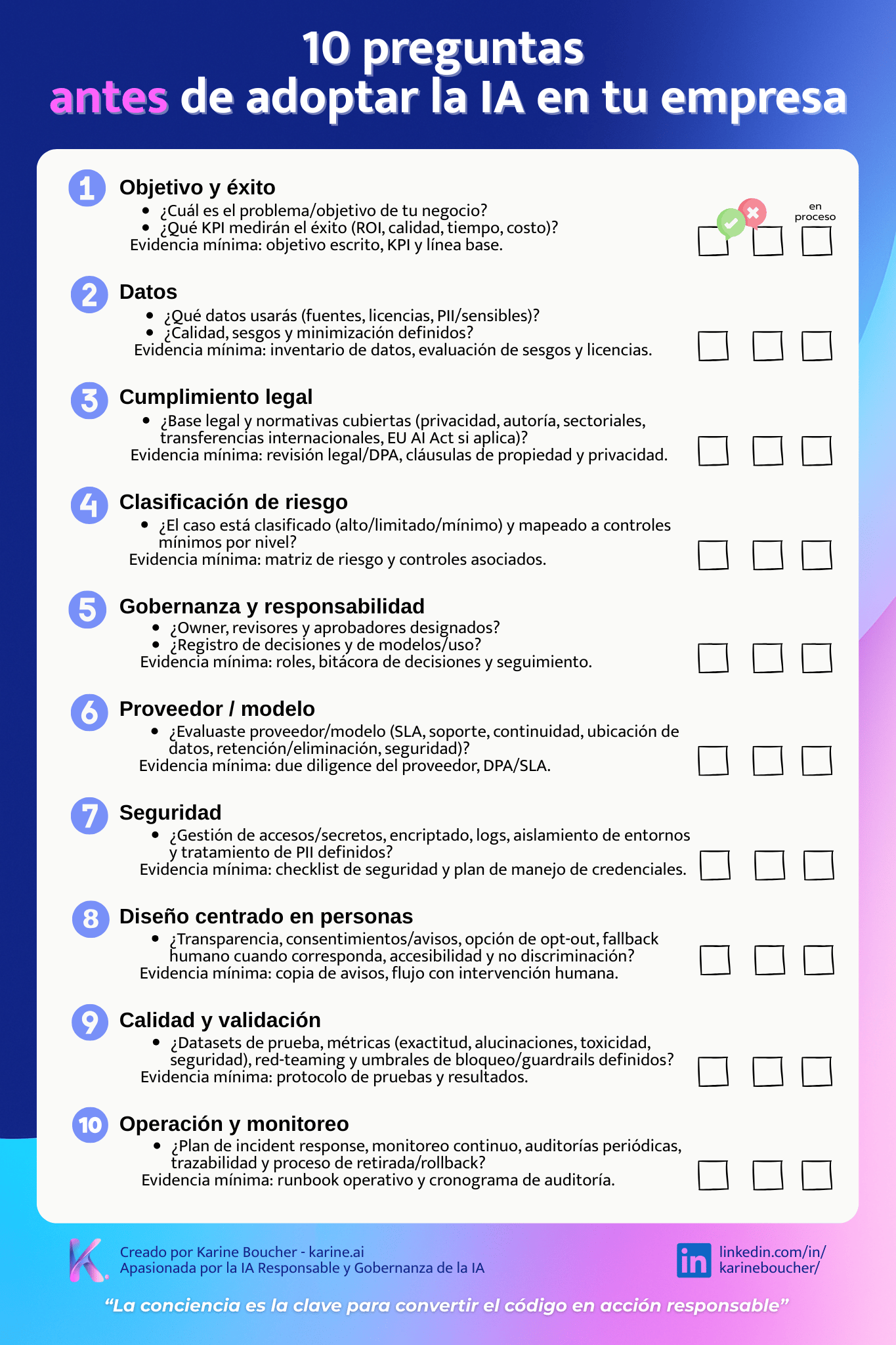

PLANTILLA DE LA SEMANA

✅ 10 preguntas antes de adoptar IA

Evalúa en 3 minutos si una herramienta es segura y cumple lo básico.

✍🏼 Cómo lo uso yo: es mi 1a hoja en diagnósticos; si puntúa bajo o medio, no avanzo verificar mis controles. |

¿Lo hacemos juntos?

“BYOAI Express” es tu radiografía de usos de IA, análisis de riesgos y controles mínimos y plan 30/60/90.

EL LIBRO QUE TE RECOMIENDO

📚 Atlas of AI 📚

Esta semana, en el “Club de Lectura de IA Responsable”, te recomiendo Atlas de la IA de Kate Crawford.

¿Por qué se destaca este libro?

Un libro imprescindible para mirar la IA más allá del “código”: recursos, trabajo, datos y poder en toda su cadena de valor. Lee mi reseña completa.

📢 Tienes un equipo o comunidad interesada en IA Responsable?

Comparte esta newsletter con ellos.

HUMOR RESPONSABLE

¡Y hasta aquí por hoy!

Si te sirvió, respóndeme y cuéntame qué quisieras ver en la próxima edición.

¿A quién más le ayuda?

Reenvíala a tu equipo o compárteles el link de suscripción.

Esta semana, quiero agradecer a Alfonso Govela, Renato Vaccaro Mutze, Braulio Campos Menchén y Arturo Marzal Higuero por sus comentarios para mejorar esta edición. Gracias de todo corazón!

Con gratitud y té en mano ☕, Karine Mamá, apasionada con la IA Responsable a beneficio de las personas y también AI Governance Consultant & WiAIG Mexico Leader |

Todas las fuentes fueron verificadas y con fecha; si ves un error, respóndeme y lo corrijo en la versión web.